作者:张悦

图片:杨浦东、主办方提供

从第一个战胜围棋世界冠军的Alpha Go,

到可预测蛋白结构的Alpha Fold,

再到如今的ChatGPT……

AI for Science正一步步走进现实。

科研界中的许多学者,正在拥抱AI所带来的便利。2018年沃尔夫化学奖得主、加州大学伯克利分校讲席教授奥马尔·亚基谈道,在一开始自己的学生尝试使用ChatGPT时,他对此非常怀疑,“不知道它到底有没有用”,但现在的他已经成为了一个ChatGPT的“信任者”:ChatGPT毫无疑问,加速了团队的科研工作,“对我来说做这些事情,如果没有ChatGPT,可能要花额外的十年。”

“AI For Science是推动科学研究范式变革,实现科技原始创新策源的利器,拥有引爆产业创新核爆点的巨大潜能。”在论坛上,中国科学院院士、复旦大学校长金力说道,AI For Science正带来一场科研范式的变革。也正因此,金力谈道,高校有责任在AI时代为科学理念的普及、科学应用的拓展、科学伦理的探讨,发挥高校的引领和导向作用,使得更多的群体、更多的领域共享AI时代的红利。

“可以说,当前的单打独斗已经不适应大科学时代的科技创新,所以要进行有组织的科研——推动跨学科的交叉研究,激发创新突破,强化产教融合,加强与企业的产学研深度融合。”金力表示。

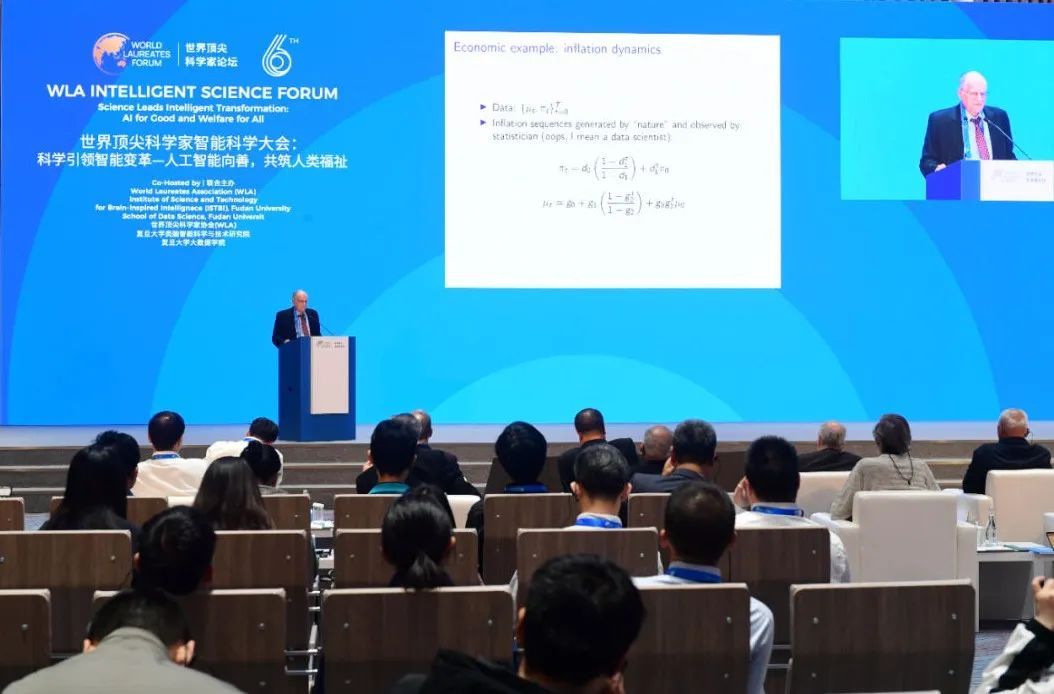

吸收了大量数据和知识的大模型令人惊叹,它们能找到一些有趣的范式,但却有一点不足之处:不擅长谈论不确定性,而这个世界却每时每刻都充满着不确定性。2022年世界顶尖科学家协会奖“智能科学或数学奖”得主,加州大学伯克利分校电子工程与计算机科学系、统计学系杰出冠名教授迈克尔·I·乔丹提到,作为一个科研工作者的合作伙伴,AI可能是存在着问题的。

“AI向善对于科学来说,意味着给我们一个正确的结果,而不是假装自己知道。”迈克尔·I·乔丹谈道,在某些科研工作中,人工智能甚至会出现“一本正经的胡说八道”。因此,他提醒道,尽管AI For Science非常有热度,但是对待它,还是要警惕。

而另一方面,学术界的AI使用也存在着学术伦理的潜在风险。“人工智能已经可以写论文了,写出来的论文可能水平跟一个普通人写出来的可以相当。我们在这种情况下,如何来确定作者的身份呢?”乔治·斯穆特发问。可见,在人工智能的时代,还有很多不透明,不可靠的问题,有待破解。

“人工智能的副作用,使得内生安全危险很可能具有不可逆的治理,不属于先发展后治理的范畴,必须做到发展和治理两手都要硬,齐抓共管,不能滞后,必须同步发展。”邬江兴谈道。也正因此,他认为,目前AI发展仅实现了有管理是远远不够,如何实现可管理,即有序、有效的,是当前面临的核心挑战。

如何看待AI可能带来的风险,人工智能是否会对人类产生威胁?加拿大工程院院士,清华大学鹏瑞教授、深圳国际研究生院数据与信息研究院院长张晓平认为,人工智能目前的状态还远不足以让人类灭绝,但人们对其的恐惧和担心也普遍存在。对此,迈克尔·I·乔丹提出,尽管危险是可能的,但“不需要付出太多的精力”,当许多年轻的科研工作者都在讨论人工智能风险的时候,机会成本也就陡然增加。

随着AI的发展,许多问题已逐渐显现。“AI可能会消灭很多的工作。”2011年诺贝尔经济学奖得主、纽约大学冠名经济与商业教授托马斯·萨金特说道。算力的垄断也同样是个潜在的问题,张晓平谈道,当前的大模型对于算力的要求非常高,因此算力一旦被垄断,则会对创新造成一定的阻碍。

在这样的情况下,人类应该如何对待AI?许多与会专家都不约而同地提到了监管的意义。“不能阻止技术的发展。”2021年阿贝尔奖得主,普林斯顿高等研究院数学学院冠名教授艾维·维格森说道,“但面对来自人工智能的威胁,应该采取行动。”他呼吁道,可以携手共建人工智能体系,避免使用者们应用这些技术做“向恶”的事情。